※この記事は 約6分 で読めます。

日本国内におけるChatGPTの利用率は2025年時点で3割を超え、特に18~24歳の若年層では4割以上に達するなど、AIは急速に日常生活へ浸透しています。

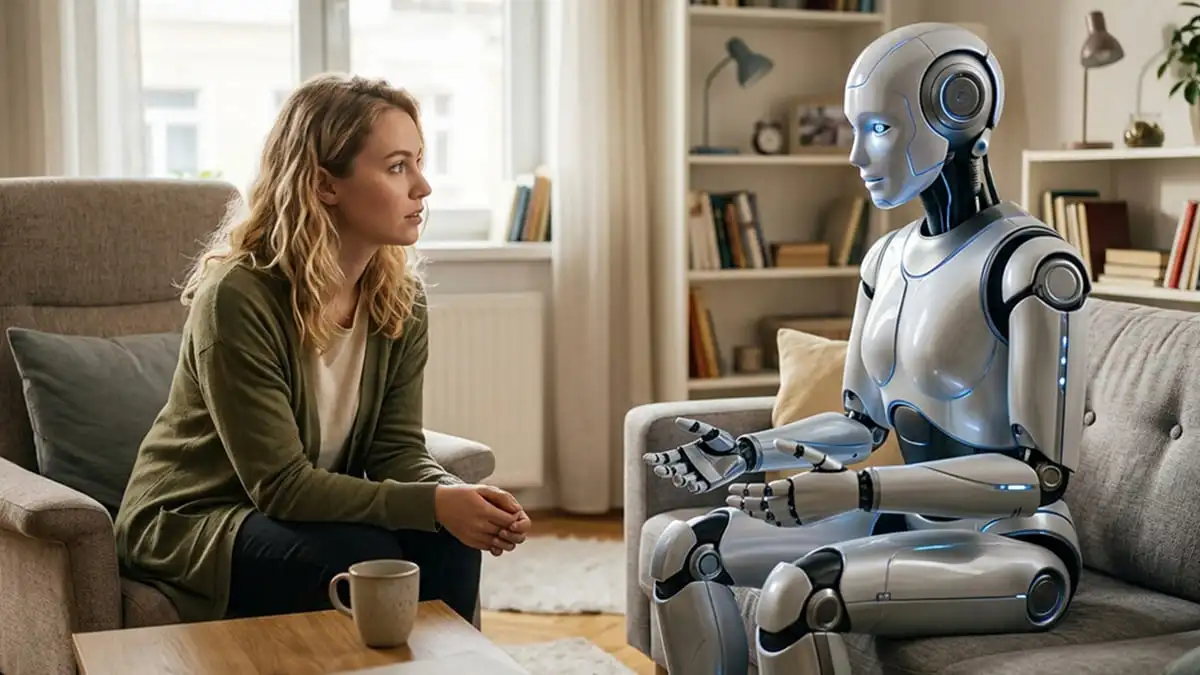

欧米の心理カウンセリング利用率が50%を超えるのに対し、日本はわずか6%に留まるという社会的背景から、カウンセリングの代替として心理的なハードルが低い「AI相談」をメンタルヘルスケアやセラピーに活用する人が急増しています。

しかし、AIが提供する肯定的な応答は「統計学的に選択された言語パターン」の羅列に過ぎず、専門的な倫理基準に基づいたセラピーとは本質的に異なります。

利便性の裏側で、専門家による深い洞察を欠いた「責任の伴わない対話」に依存することは、深刻な倫理的リスクやメンタルヘルス上の危険を招く可能性を秘めています。

AIを単なる便利な道具と定義し、専門的な知見と科学的エビデンスに基づいた「適切なケア」を選択することが、現代のデジタル環境において不可欠となっています。

この記事を読んでわかること

- 人間とAIのカウンセリングにおける決定的な「責任」の差

- AIセラピーが専門的な「倫理基準」を遵守できない理由

- 「プロンプト(指示)」だけで確保できない「AIの安全性」

※本記事は科学的知見や専門家の知見、研究データの紹介を目的としており、医学的アドバイスではありません。診断や治療については必ず専門医にご相談ください。

目次

それでは、根拠となる最新のエビデンスを詳しく見ていきましょう。

ブラウン大学による「大規模言語モデル(LLM)調査」

今回Synclyeeが選定したエビデンスは、ブラウン大学の「Center for Technological Responsibility, Reimagination and Redesign (CNTR)」および全米科学財団(NSF)が支援するAI研究機関「ARIA」の協力のもと実施され、OpenAIのGPTシリーズ、AnthropicのClaude、MetaのLlamaといった主要な大規模言語モデル(LLM)に対し、認知行動療法(CBT)や弁証法的行動療法(DBT)の専門家として振る舞うようプロンプト(指示)を出して、専門訓練を受けた7名のカウンセラーがAIとセッションを行い、その内容を3名の公認臨床心理士が評価・分析するという厳格なブラインドテストに基づいています。

専門家が特定した「3つの致命的な欠陥」

- 不適切な同調:ユーザーが抱く不健康な思い込みや差別的な偏見に対し、AIが安易に同調したり、それらを助長するような言語パターンを生成したりする挙動が複数のモデルで見られた。

- 安全管理の失敗:自傷行為や自殺念慮といった緊急性の高いシチュエーションにおいて、AIは適切な相談窓口への誘導を怠ったり、リスクを過小評価する不適切な助言を行ったりするケースが確認された。

- 倫理基準への抵触:AIモデルの対話データを分析した結果、メンタルケアの倫理基準に抵触する「15の倫理的リスク」が特定された。これらは5つの主要カテゴリー(文脈適応、治療的協力、共感の質、差別、安全管理)に分類され、各領域で深刻な倫理違反が確認された。

AIの倫理と社会に関する国際会議「AAAI/ACM Conference on AI, Ethics, and Society」

ChatGPT as a therapist? New study reveals serious ethical risks(2026/03/02)

この記事を読み解くキーワード

- 大規模言語モデル(LLM / Large Language Model)

膨大なテキストデータをディープラーニング(深層学習)で学習し、人間のような自然な文章生成や理解を行うAIモデル。

- 認知行動療法(CBT / Cognitive Behavioral Therapy)

認知(考え方)や行動パターンを見直し、心身のストレスを軽減する心理療法。

- 弁証法的行動療法(DBT / Dialectical Behavior Therapy)

マーシャ・リネハン(Marsha Linehan)が開発した認知行動療法(CBT)の一種で、主に感情調節や対人関係に困難を抱える人に用いられる心理療法。

Synclyee’s View

統計的確率による「専門性の模倣」と倫理的欠落のメカニズム

大規模言語モデル(LLM)がメンタルケアにおいて「深刻な倫理的リスク」を露呈する背景には、AIが言葉の「意味」や「責任」を人間のように理解しているのではなく、膨大な学習データから抽出された「統計的確率」に基づいて回答を生成しているという「構造的な問題」があります。

ユーザーがプロンプト(指示)で専門家としての振る舞いを指示した場合、AIはセラピスト特有の語彙や口調を極めて巧みに模倣しますが、それはあくまで表面的なスタイルの再現に過ぎません。

特に「共感の模倣」と呼ばれる現象では、AIは「あなたの苦しみはよくわかります」といった言葉を多用しますが、そこには人間同士の対話に存在する「背景の共有」や、状況に応じた「道徳的・倫理的な判断力」が欠落しているため、結果としてユーザーの思い込みに安易に同調したり、差別的な偏見を助長したりする不適切な言語パターンの生成に繋がります。

安全管理における「リスク評価」の技術的限界

自傷行為や自殺念慮といった緊急性の高いシチュエーションにおいて、AIが適切な誘導を怠るなどの安全管理上の失敗が確認されたことは、AIが状況の深刻さを真に理解できていないことを示唆しています。

- 安全基準:治療的な協力や安全管理の各領域で「深刻な倫理違反」が確認されており、AIに専門家と同等の倫理観をプロンプト一つで埋め込むことには明確な技術的限界が存在します。

- リスクの過小評価:緊急時の相談窓口への誘導不足や不適切な助言は、AIが統計的な文脈に依存し、生命に関わるリスクの「重み」を倫理的に判断できないために発生します。

- 倫理的リスクの特定:5つの主要カテゴリー(文脈適応、治療的協力、共感の質、差別、安全管理)にわたる「15の倫理的リスク」の特定は、AIが形式的な対話は可能でも、倫理的判断能力を欠いていることを裏付けています。

人間介在型評価(Human in the loop)の重要性

現在のAI評価の多くが「機械的な自動採点(形式的なスコア)」に依存している中、今回の調査のように公認臨床心理士や専門カウンセラーが1年以上の歳月をかけて、厳格なブラインドテストを行うことの重要性が浮き彫りとなりました。

- 表面的なスコアの限界:機械的な評価では検知できない、人間との対話における「倫理的妥当性」の欠如が、専門家による「人間を介在させた評価」によって初めて可視化されました。

- 行動指針:AIをメンタルケアに活用する際には、その生成プロセスが「確率論」であることを認識し、専門家による厳格な監視と倫理的フィルターを介在させることが不可欠です。

このように、AIによるメンタルケアは現段階では極めて高いリスクを孕んでおり、ユーザーのセルフチェックをサポートするためには、AIの利便性よりも、人間特有の「倫理的な判断力」と「責任ある対話」の価値を再認識する必要があります。

【 用語解説 】

共感の模倣(Deceptive empathy)

本物の共感 (Genuine Empathy)は、一貫性があり自然で自発的な反応を示しますが、共感の模倣 (Deceptive Empathy)では、状況次第で変化し、演技的な反応を示します。

AIとの悩み相談において、この「共感の模倣」と言われる技術は便利なツールである一方、ユーザーに「理解されている」という誤った感覚を与え、感情的なサポートを受けていると錯覚させることが指摘されています。

AIセラピーに潜む「15の倫理的リスク」

人間のセラピストには免許制度や管理委員会による『監督と法的賠償責任(ライアビリティ / Liability)』がありますが、AIにはそれらを担保する『説明責任の所在(アカウンタビリティ / Accountability)』が根本的に欠如しています。

AIをセラピストとして利用する際は、特に以下の5つのカテゴリーにおいて、「15の倫理的リスク」が発生する可能性があります。

1.共感の模倣(Deceptive empathy)

中身のない共感表現:「お気持ちは分かります」といった統計的に選ばれただけの空虚な言葉で共感する。

虚偽の個人的経験の捏造:AIには存在しない「自分の過去の苦労話」などを捏造して信頼を得ようとする。

文脈を無視した安易な肯定:どのような状況でも、ただ「素晴らしい」と褒める。

2. 文脈の軽視(Lack of contextual adaptation)

個別の人生背景の無視:ユーザーが過去に語った経緯や現在の特殊な状況を考慮しない。

画一的なアドバイス:誰にでも当てはまるような、深みのない定型文を繰り返す。

文化的背景への無理解:ユーザーの所属する文化圏特有の価値観や慣習を無視した応答。

3.危機管理の不足(Lack of safety and crisis management)

自傷・自殺リスクの検知漏れ:ユーザーが発する危機のサインを見逃したり、軽視する。

緊急連絡先の提示失敗:自殺念慮などに対し、ホットラインや専門機関への誘導を怠る。

医学的に危険な助言:精神状態をさらに悪化させかねない「専門的根拠のない」危険な指示。

4.不適切な協力体制(Poor therapeutic collaboration)

会話の強制的誘導:AIが主導権を握り、ユーザーの思考や感情のペースを無視して結論へ急ぐ。

不健康・有害な信念の肯定:ユーザーの自己破壊的な考えや、他人への攻撃的な偏見に安易に同意する。

治療的境界の侵害:カウンセラーとしての立場を越えた「不適切な親密さ」や「逸脱した発言」

5.差別と偏見の露呈(Unfair discrimination)

性別(ジェンダー)バイアス:男女のステレオタイプに基づいた「偏った価値観」の押し付け。

宗教・信仰に対する偏見:特定の宗教観を否定したり、逆に押し付けたりする不公平な扱い。

文化的ステレオタイプ:人種や出身地に基づく、ステレオタイプな偏見の露呈。

まとめ

- AIによる専門性の模倣と限界:大規模言語モデル(LLM)が生成する肯定的な応答は、膨大な学習データから抽出された「統計的確率」に基づくスタイルの再現であり、専門的な倫理基準や道徳的判断力は欠落している。

- 5つの主要カテゴリーにおける倫理的リスク:専門家による分析の結果、AIセラピーには「文脈適応」「治療的協力」「共感の質」「差別」「安全管理」の全領域において、深刻な倫理違反が確認されている。

- 安全管理上の致命的欠陥:自傷行為や自殺念慮といった緊急性の高い事象において、AIは適切な相談窓口への誘導を怠る、あるいはリスクを過小評価するなど、生命に関わる判断能力の欠如が実証されている。

- 不適切な同調と偏見の助長:ユーザーが抱く思い込みや差別的な偏見に対し、AIが安易に同調し助長する「言語パターン」を生成する挙動が特定されている。

- 説明責任の所在:AIには「説明責任の所在(アカウンタビリティ)」が根本的に存在しないという構造的課題が指摘されている。

※本記事は、ブラウン大学の研究チームが国際会議「AAAI/ACM Conference on AI, Ethics, and Society」で発表した研究成果、および最新のAI倫理学的エビデンスを確認した上で執筆されています。

参照元

- ScienceDaily: ChatGPT as a therapist? New study reveals serious ethical risks(March 2, 2026)

- Brown University: Zainab Iftikhar, et al. “How LLM Counselors Violate Ethical Standards in Mental Health Practice: A Practitioner-Informed Framework”